Modèle de chèque bancaire Intelligence documentaire

Le modèle de chèque bancaire Intelligence Documentaire combine de puissantes capacités de reconnaissance optique de caractères (OCR) à des modèles Deep Learning pour analyser et extraire des données à partir de chèques bancaires américains. L’API analyse les chèques imprimés, extrait les informations clés et retourne une représentation des données au format JSON structuré. La dernière version 4.0 pour les chèques bancaires prend en charge la détection des signatures sur les chèques bancaires.

| Fonctionnalité | version | ID de modèle |

|---|---|---|

| Modèle de chèque | v4.0 : 2024-11-30 (GA) | prebuilt-check.us |

Extraction des données de chèque

Un chèque est un moyen sécurisé de transférer une somme du compte de l’émetteur vers le compte du destinataire. Les entreprises utilisent des chèques pour payer leurs fournisseurs, en tant que document signé pour indiquer à la banque de payer. Découvrez comment les données, y compris les détails du chèque, les détails du compte, le montant et le mémo, sont extraites des chèques bancaires américains. Vous avez besoin des ressources suivantes :

Un abonnement Azure : vous pouvez en créer un gratuitement

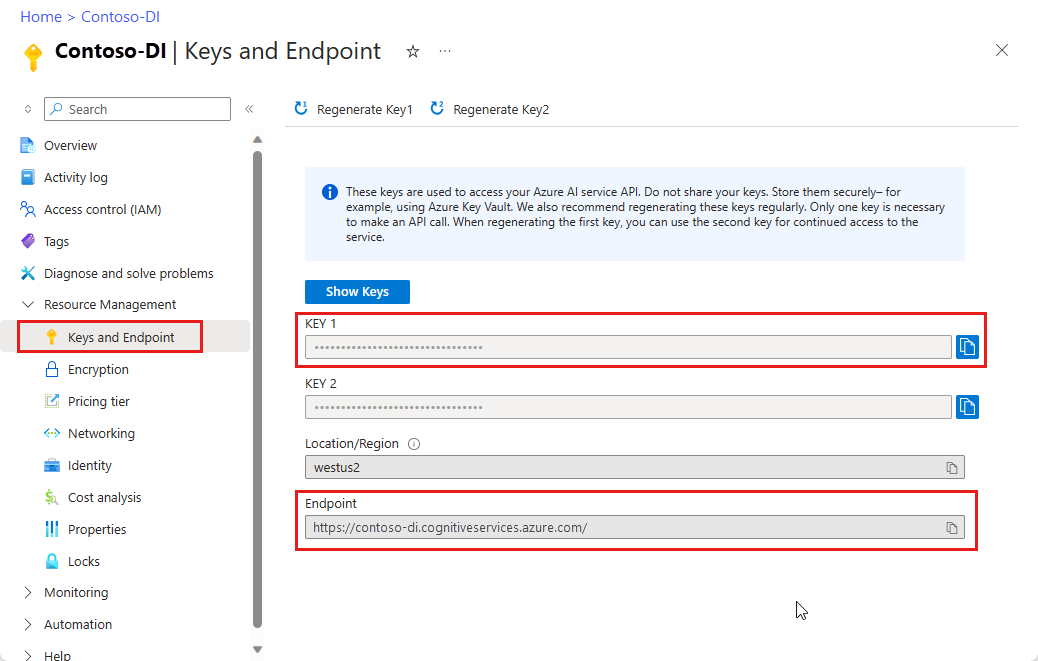

Instance Intelligence documentaire dans le Portail Azure. Vous pouvez utiliser le niveau tarifaire gratuit (

F0) pour tester le service. Une fois votre ressource déployée, sélectionnez Accéder à la ressource pour accéder à la clé et au point de terminaison.

Document Intelligence Studio

Remarque

Le Studio d’Intelligence documentaire est disponible avec les API v3.1 et v3.0.

Sur la page d’accueil d’Intelligence documentaire Studio, sélectionnez Chèque.

Vous pouvez analyser l’exemple de chèque ou charger vos propres fichiers.

Sélectionnez le bouton Exécuter l’analyse et, si nécessaire, configurez les Options d’analyse :

Critères des entrées

Formats de fichiers pris en charge :

Modèle PDF Image : JPEG/JPG,PNG,BMP,TIFF,HEIFMicrosoft Office :

Word (DOCX), Excel (XLSX), PowerPoint (PPTX), HTMLLire ✔ ✔ ✔ Layout ✔ ✔ ✔ Document général ✔ ✔ Prédéfinie ✔ ✔ Extraction personnalisée ✔ ✔ Classification personnalisée ✔ ✔ ✔ Pour de meilleurs résultats, fournissez une photo nette ou une copie de qualité par document.

Pour les PDF et TIFF, jusqu'à 2 000 pages peuvent être traitées (avec un abonnement gratuit, seules les deux premières pages sont traitées).

La taille de fichier pour l’analyse de documents est de 500 Mo pour le niveau payant (S0) et de

4Mo pour le niveau gratuit (F0).Les dimensions de l’image doivent être comprises entre 50 pixels x 50 pixels et 10 000 pixels x 10 000 pixels.

Si vos fichiers PDF sont verrouillés par mot de passe, vous devez supprimer le verrou avant leur envoi.

La hauteur minimale du texte à extraire est de 12 pixels pour une image de 1024 x 768 pixels. Cette dimension correspond environ à un texte de

8points à 150 points par pouce (ppp).Pour la formation de modèles personnalisés, le nombre maximal de pages pour les données de formation est de 500 pour le modèle personnalisé et 50 000 pour le modèle neural personnalisé.

Pour l’apprentissage du modèle d’extraction personnalisé, la taille totale des données d’entraînement est de 50 Mo pour le modèle de gabarit et de

1Go pour le modèle neuronal.Pour l’apprentissage du modèle de classification personnalisé, la taille totale des données d’entraînement est de

1Go, avec un maximum de 10 000 pages. Pour 2024-11-30 (GA), la taille totale des données d’apprentissage est de2Go avec un maximum de 10 000 pages.

Langues et régions prises en charge

Pour obtenir la liste complète des langues prises en charge, consultez notre page Prise en charge des langues du modèle prédéfini.

Extractions de champs

Pour connaître les champs d'extraction de documents pris en charge, consulter la page Schéma de modèle de chèque bancaire de notre référentiel d'exemples GitHub.

Paramètres régionaux pris en charge

La version 2024-11-30 (GA) prebuilt-check.us prend en charge les paramètres régionaux en-us.

Étapes suivantes

Traitez vos propres formulaires et documents avec Studio Intelligence Documentaire.

Effectuez un démarrage rapide Intelligence Documentaire et commencez à créer une application de traitement de documents dans le langage de développement de votre choix.