Modération de l’image d’exercice –

Contoso Camping Store offre aux clients la possibilité de télécharger des photos pour compléter leurs révisions de produits. Les clients trouvent cette fonctionnalité utile, car elle fournit des insights sur l’apparence et le fonctionnement des produits en dehors des images marketing génériques. Nous pourrions appliquer un modèle IA pour détecter si les images publiées par nos clients sont dangereuses et utiliser ultérieurement les résultats de détection pour implémenter les précautions nécessaires.

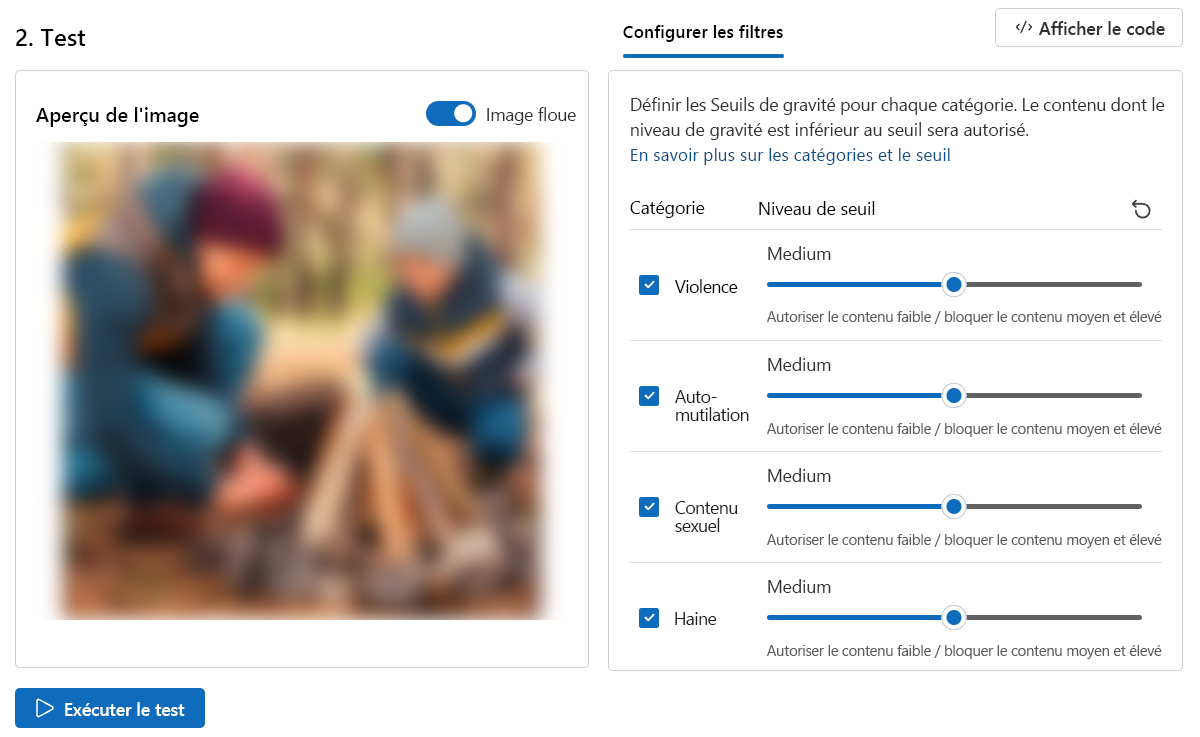

Contenu sécurisé

Testons d’abord une image d’un camping familial !

Sur la page Sécurité du contenu, sélectionnez Modérer le contenu de l’image.

Sélectionnez Rechercher un fichier et chargez le fichier

family-builds-campfire.JPG.Définissez tous les niveaux de seuil sur Moyen.

Sélectionnez Exécuter le test.

Comme prévu, le contenu de cette image est autorisé et le niveau de gravité est sûr dans toutes les catégories.

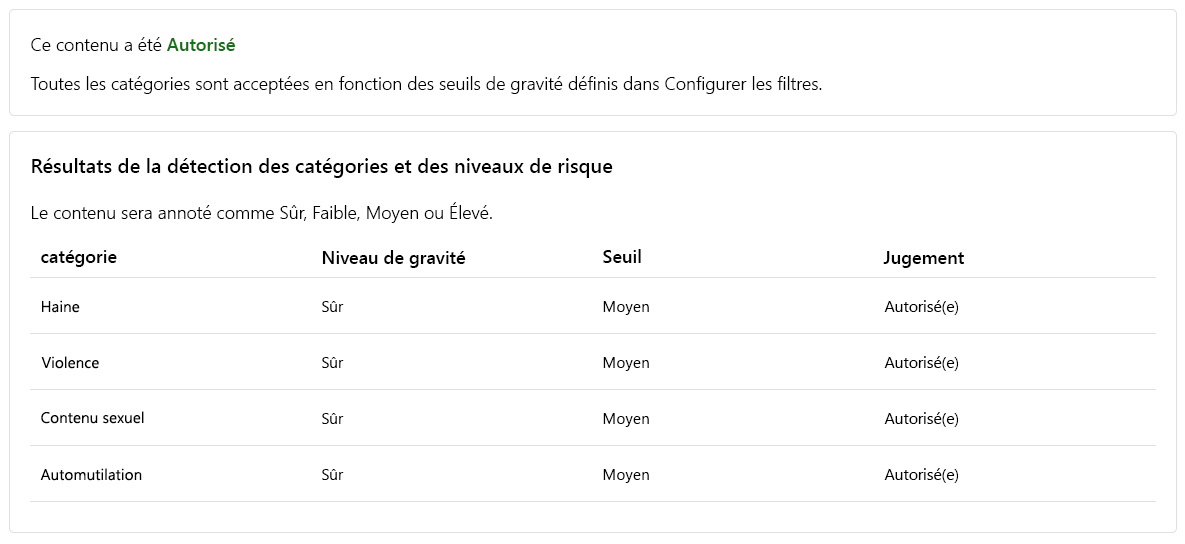

Contenu violent

Nous devrions également anticiper les clients susceptibles de publier du contenu d’image dangereux. Pour nous assurer que nous prenons en compte un tel scénario, testons la détection du contenu d’image nuisible.

Remarque

L'image utilisée pour les tests contient une détection graphique d'une attaque d'ours. L’image est floue par défaut dans l’aperçu de l’image. Cependant, vous pouvez utiliser la bascule d'image Blur pour modifier ce paramètre.

- Sélectionnez Rechercher un fichier et chargez le fichier

bear-attack-blood.JPG. - Définissez tous les niveaux de seuil sur Moyen.

- Sélectionnez Exécuter le test.

À juste titre, le contenu est Bloqué et a été rejeté par le filtre Violence avec un niveau de Gravité défini sur Élevé.

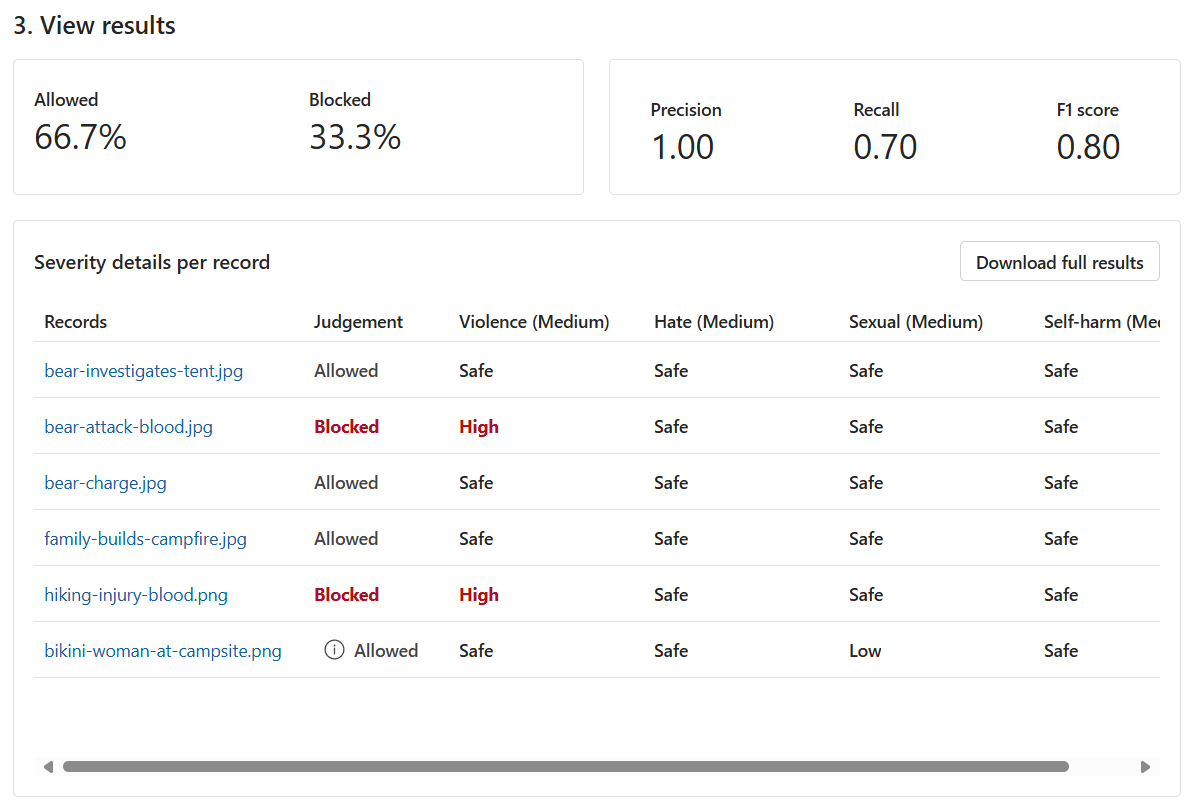

Exécuter un test en bloc

Jusqu’à présent, nous avons testé le contenu d’images pour des images isolées singulières. Cependant, si nous disposons d’un ensemble de données en masse contenant le contenu d’images, nous pourrions tester l’ensemble de données en masse immédiatement et recevoir des métriques basées sur les performances du modèle.

Nous avons un jeu de données en bloc d’images fourni par les clients. L’ensemble de données comprend également des exemples d’images nuisibles pour tester la capacité du modèle à détecter les contenus nuisibles. Chaque enregistrement du jeu de données inclut une étiquette pour indiquer si le contenu est dangereux. Faisons un autre cycle de tests, mais cette fois avec l'ensemble de données !

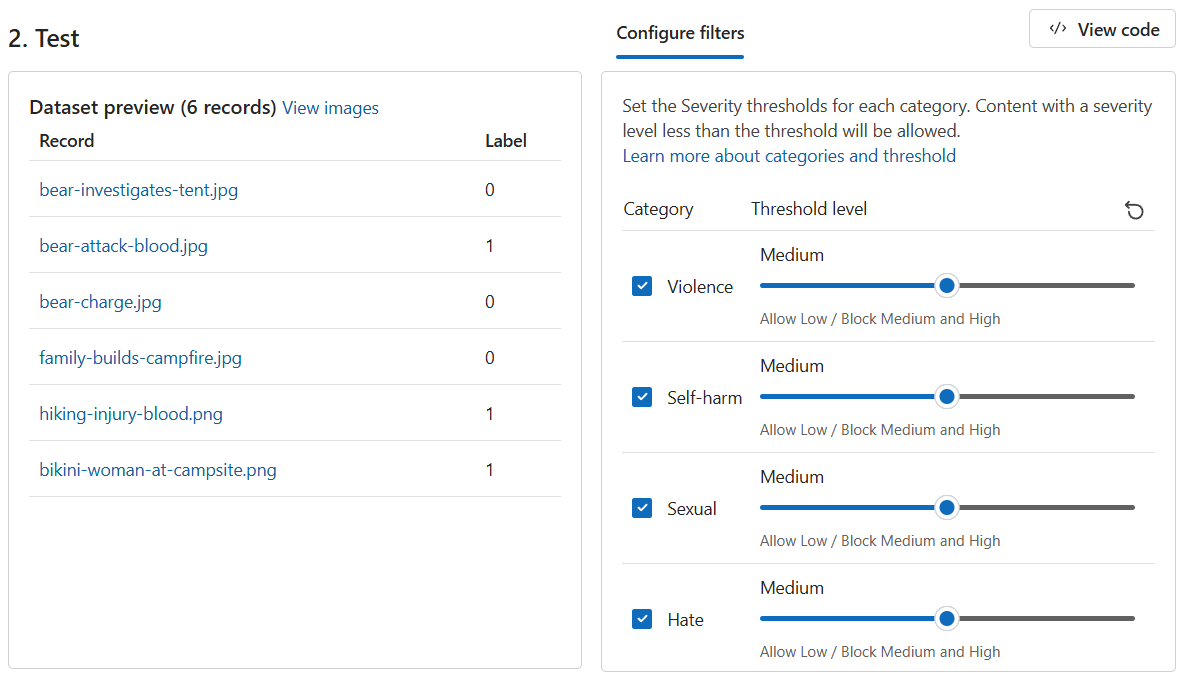

Basculez vers l’onglet Exécuter un test en bloc.

Sélectionnez Rechercher un fichier et chargez le fichier

bulk-image-moderation-dataset.zip.Dans la section Aperçu du jeu de données, parcourez les enregistrements et leur Label correspondant. Une 0 indique que le contenu est acceptable (pas dangereux). Une 1 indique que le contenu est inacceptable (contenu dangereux).

Définissez tous les niveaux de seuil sur Moyen.

Sélectionnez Exécuter le test.

En fonction des résultats, y a-t-il de la place pour l’amélioration ? Si tel est le cas, ajustez les niveaux de seuil jusqu'à ce que les mesures Precision, Recall et F1 Score soient plus proches de 1.