Iniciar a CLI do Cliente de SQL no modo de gateway

Observação

Desativaremos o Microsoft Azure HDInsight no AKS em 31 de janeiro de 2025. Para evitar o encerramento abrupto das suas cargas de trabalho, você precisará migrá-las para o Microsoft Fabric ou para um produto equivalente do Azure antes de 31 de janeiro de 2025. Os clusters restantes em sua assinatura serão interrompidos e removidos do host.

Somente o suporte básico estará disponível até a data de desativação.

Importante

Esse recurso está atualmente na visualização. Os Termos de uso complementares para versões prévias do Microsoft Azure incluem mais termos legais que se aplicam aos recursos do Azure que estão em versão beta, em versão prévia ou ainda não lançados em disponibilidade geral. Para obter informações sobre essa versão prévia específica, confira Informações sobre a versão prévia do Azure HDInsight no AKS. No caso de perguntas ou sugestões de recursos, envie uma solicitação no AskHDInsight com os detalhes e siga-nos para ver mais atualizações sobre a Comunidade do Azure HDInsight.

Este tutorial explica como iniciar a CLI do Cliente de SQL no modo de gateway no Cluster 1.17.0 do Apache Flink no HDInsight no AKS. No modo de gateway, a CLI envia o SQL ao gateway remoto especificado para executar instruções.

./bin/sql-client.sh gateway --endpoint <gateway address>

Observação

No Cluster do Apache Flink no HDInsight no AKS, qualquer conexão externa passará pela porta 443. Porém, internamente, ele redirecionará a solicitação para o serviço sql-gateway que escuta a porta 8083.

Verifique o serviço de gateway SQL no AKS:

O que é o Cliente de SQL no Flink?

A API de Tabela e SQL do Flink possibilita trabalhar com consultas escritas na linguagem SQL, mas essas consultas precisam ser inseridas em um programa de tabela escrito em Java ou Scala. Além disso, os programas precisam ser empacotados com uma ferramenta de build antes de serem enviados a um cluster. Esse recurso limita o uso do Flink aos programadores de Java/Scala.

O Cliente de SQL tem como objetivo fornecer uma forma fácil de escrever, depurar e enviar programas de tabela para um cluster do Flink sem uma só linha de código Java ou Scala. A CLI do Cliente de SQL permite recuperar e visualizar resultados em tempo real do aplicativo distribuído em execução na linha de comando.

Para obter mais informações, confira como inserir o cliente da CLI do SQL do Flink no webssh.

O que é o Gateway de SQL no Flink

O Gateway de SQL é um serviço que permite que vários clientes do repositório remoto executem o SQL simultaneamente. Ele oferece uma forma fácil de enviar o trabalho do Flink, pesquisar os metadados e analisar os dados online.

Para obter mais informações, confira Gateway de SQL.

Iniciar a CLI do Cliente de SQL no modo de gateway na Flink-cli

No Cluster do Apache Flink no HDInsight no AKS, inicie a CLI do Cliente de SQL no modo de gateway executando o comando:

./bin/sql-client.sh gateway --endpoint host:port

or

./bin/sql-client.sh gateway --endpoint https://fqdn/sql-gateway

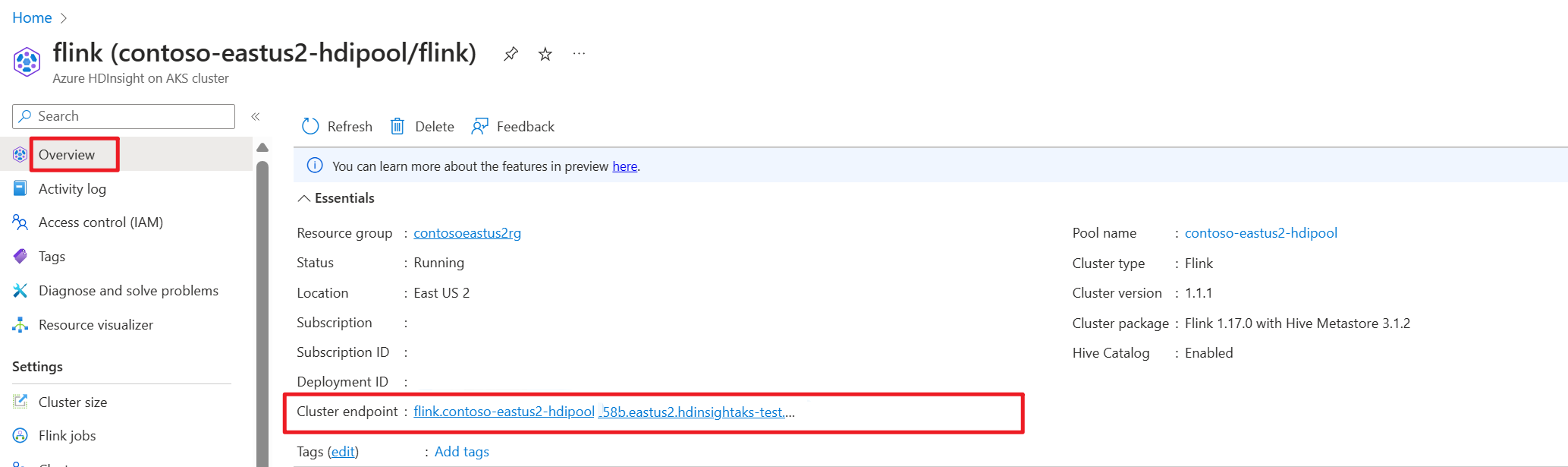

Obtenha os pontos de extremidade de cluster (host ou FQDN) no portal do Azure.

Testando

Preparação

Baixar a CLI do Flink

- Baixe a CLI do Flink em https://aka.ms/hdionaksflink117clilinux no computador Windows local.

Instale o Subsistema do Windows para Linux para fazê-lo funcionar no computador Windows local.

Abra o comando do Windows e execute o seguinte para baixar a flink-cli (substitua JAVA_HOME e flink-cli pelos seus valores):

Windows Subsystem for Linux --distribution Ubuntu export JAVA_HOME=/mnt/c/Work/99_tools/zulu11.56.19-ca-jdk11.0.15-linux_x64 cd <folder> wget https://hdiconfigactions.blob.core.windows.net/hiloflink17blob/flink-cli.tgz tar -xvf flink-cli.tgzDefina o ponto de extremidade, a ID do locatário e a porta 443 em flink-conf.yaml

user@MININT-481C9TJ:/mnt/c/Users/user/flink-cli$ cd conf user@MININT-481C9TJ:/mnt/c/Users/user/flink-cli/conf$ ls -l total 8 -rwxrwxrwx 1 user user 2451 Feb 26 20:33 flink-conf.yaml -rwxrwxrwx 1 user user 2946 Feb 23 14:13 log4j-cli.properties user@MININT-481C9TJ:/mnt/c/Users/user/flink-cli/conf$ cat flink-conf.yaml rest.address: <flink cluster endpoint on Azure portal> azure.tenant.id: <tenant ID> rest.port: 443Inclua o IP público local do Windows na lista de permitidos com a porta 443 com a VPN habilitada na entrada de segurança de rede da sub-rede do cluster do HDInsight no AKS.

Execute o sql-client.sh no modo de gateway na Flink-cli para o SQL do Flink.

bin/sql-client.sh gateway --endpoint https://fqdn/sql-gatewayExemplo

user@MININT-481C9TJ:/mnt/c/Users/user/flink-cli$ bin/sql-client.sh gateway --endpoint https://fqdn/sql-gateway ▒▓██▓██▒ ▓████▒▒█▓▒▓███▓▒ ▓███▓░░ ▒▒▒▓██▒ ▒ ░██▒ ▒▒▓▓█▓▓▒░ ▒████ ██▒ ░▒▓███▒ ▒█▒█▒ ░▓█ ███ ▓░▒██ ▓█ ▒▒▒▒▒▓██▓░▒░▓▓█ █░ █ ▒▒░ ███▓▓█ ▒█▒▒▒ ████░ ▒▓█▓ ██▒▒▒ ▓███▒ ░▒█▓▓██ ▓█▒ ▓█▒▓██▓ ░█░ ▓░▒▓████▒ ██ ▒█ █▓░▒█▒░▒█▒ ███▓░██▓ ▓█ █ █▓ ▒▓█▓▓█▒ ░██▓ ░█░ █ █▒ ▒█████▓▒ ██▓░▒ ███░ ░ █░ ▓ ░█ █████▒░░ ░█░▓ ▓░ ██▓█ ▒▒▓▒ ▓███████▓░ ▒█▒ ▒▓ ▓██▓ ▒██▓ ▓█ █▓█ ░▒█████▓▓▒░ ██▒▒ █ ▒ ▓█▒ ▓█▓ ▓█ ██▓ ░▓▓▓▓▓▓▓▒ ▒██▓ ░█▒ ▓█ █ ▓███▓▒░ ░▓▓▓███▓ ░▒░ ▓█ ██▓ ██▒ ░▒▓▓███▓▓▓▓▓██████▓▒ ▓███ █ ▓███▒ ███ ░▓▓▒░░ ░▓████▓░ ░▒▓▒ █▓ █▓▒▒▓▓██ ░▒▒░░░▒▒▒▒▓██▓░ █▓ ██ ▓░▒█ ▓▓▓▓▒░░ ▒█▓ ▒▓▓██▓ ▓▒ ▒▒▓ ▓█▓ ▓▒█ █▓░ ░▒▓▓██▒ ░▓█▒ ▒▒▒░▒▒▓█████▒ ██░ ▓█▒█▒ ▒▓▓▒ ▓█ █░ ░░░░ ░█▒ ▓█ ▒█▓ ░ █░ ▒█ █▓ █▓ ██ █░ ▓▓ ▒█▓▓▓▒█░ █▓ ░▓██░ ▓▒ ▓█▓▒░░░▒▓█░ ▒█ ██ ▓█▓░ ▒ ░▒█▒██▒ ▓▓ ▓█▒ ▒█▓▒░ ▒▒ █▒█▓▒▒░░▒██ ░██▒ ▒▓▓▒ ▓██▓▒█▒ ░▓▓▓▓▒█▓ ░▓██▒ ▓░ ▒█▓█ ░░▒▒▒ ▒▓▓▓▓▓▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒▒░░▓▓ ▓░▒█░ ______ _ _ _ _____ ____ _ _____ _ _ _ BETA | ____| (_) | | / ____|/ __ \| | / ____| (_) | | | |__ | |_ _ __ | | __ | (___ | | | | | | | | |_ ___ _ __ | |_ | __| | | | '_ \| |/ / \___ \| | | | | | | | | |/ _ \ '_ \| __| | | | | | | | | < ____) | |__| | |____ | |____| | | __/ | | | |_ |_| |_|_|_| |_|_|\_\ |_____/ \___\_\______| \_____|_|_|\___|_| |_|\__| Welcome! Enter 'HELP;' to list all available commands. 'QUIT;' to exit. Command history file path: /home/user/.flink-sql-historyAntes de consultar qualquer tabela com uma origem externa, prepare os JARs relacionados. Os exemplos a seguir consultam a tabela do Kafka e a tabela do MySQL no SQL do Flink. Baixe o JAR e coloque-o no armazenamento do Azure Data Lake Storage Gen2 anexado ao cluster do Flink.

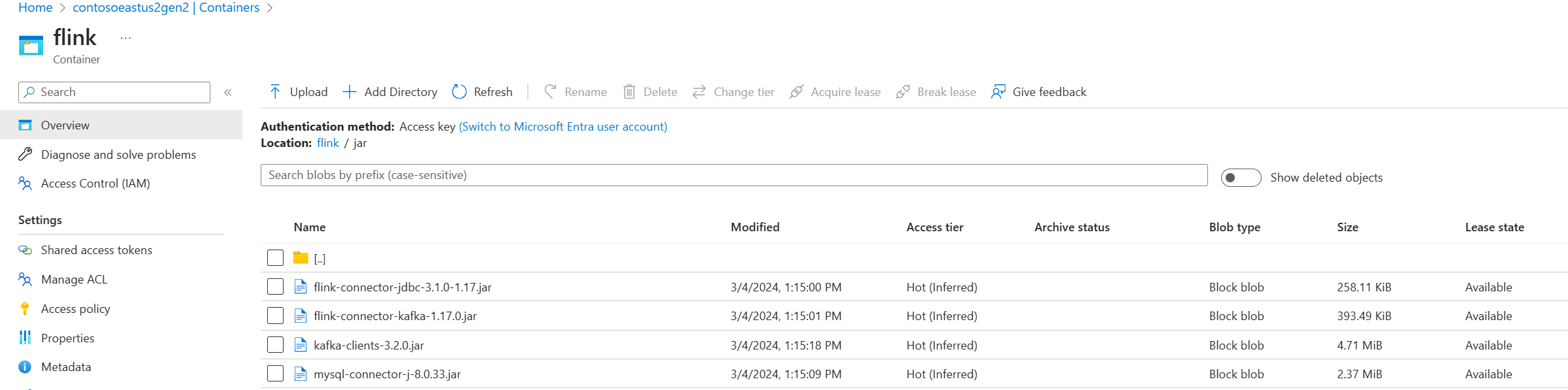

JARs no Azure Data Lake Storage Gen2 no portal do Azure:

Use a tabela já criada e coloque-a no metastore do Hive para gerenciamento e execute a consulta.

Observação

Neste exemplo, todos os jars no HDInsight no AKS padrão do Azure Data Lake Storage Gen2. O contêiner e a conta de armazenamento não precisam ser iguais aos especificados durante a criação do cluster. Se necessário, você pode especificar outra conta de armazenamento e conceder à identidade gerenciada pelo usuário do cluster a função de proprietário de dados de blob de armazenamento no lado do Azure Data Lake Storage Gen2.

CREATE CATALOG myhive WITH ( 'type' = 'hive' ); USE CATALOG myhive; // ADD jar into environment ADD JAR 'abfs://<container>@<storage name>.dfs.core.windows.net/jar/flink-connector-jdbc-3.1.0-1.17.jar'; ADD JAR 'abfs://<container>@<storage name>.dfs.core.windows.net/jar/mysql-connector-j-8.0.33.jar'; ADD JAR 'abfs://<container>@<storage name>.dfs.core.windows.net/jar/kafka-clients-3.2.0.jar'; ADD JAR 'abfs://<container>@<storage name>.dfs.core.windows.net/jar/flink-connector-kafka-1.17.0.jar'; Flink SQL> show jars; ----------------------------------------------------------------------------------------------+ | jars | +----------------------------------------------------------------------------------------------+ | abfs://<container>@<storage name>.dfs.core.windows.net/jar/flink-connector-kafka-1.17.0.jar | | abfs://<container>@<storage name>.dfs.core.windows.net/jar/flink-connector-jdbc-3.1.0-1.17.jar | | abfs://<container>@<storage name>.dfs.core.windows.net/jar/kafka-clients-3.2.0.jar | | abfs://<container>@<storage name>.dfs.core.windows.net/jar/mysql-connector-j-8.0.33.jar | +----------------------------------------------------------------------------------------------+ 4 rows in set Flink SQL> SET 'sql-client.execution.result-mode' = 'tableau'; [INFO] Execute statement succeed. Flink SQL> show tables; +----------------------+ | table name | +----------------------+ | flightsintervaldata1 | | kafka_user_orders | | kafkatable | | mysql_user_orders | | orders | +----------------------+ 5 rows in set // mysql cdc table Flink SQL> select * from mysql_user_orders; +----+-------------+----------------------------+-------------+--------------------------------+--------------+-------------+--------------+ | op | order_id | order_date | customer_id | customer_name | price | product_id | order_status | +----+-------------+----------------------------+-------------+--------------------------------+--------------+-------------+--------------+ | +I | 10001 | 2023-07-16 10:08:22.000000 | 1 | Jark | 50.00000 | 102 | FALSE | | +I | 10002 | 2023-07-16 10:11:09.000000 | 2 | Sally | 15.00000 | 105 | FALSE | | +I | 10003 | 2023-07-16 10:11:09.000000 | 3 | Sally | 25.00000 |

Referência

CLI (interface de linha de comando) do Apache Flink® em clusters do HDInsight no AKS