Importieren einer Azure OpenAI-API

GILT FÜR: Alle API Management-Ebenen

Dieser Artikel zeigt zwei Möglichkeiten, eine Azure OpenAI Service-API als REST API in eine Azure API Management-Instanz zu importieren:

- Importieren einer Azure OpenAI-API direkt aus dem Azure OpenAI Service

- Laden Sie die OpenAPI-Spezifikation für Azure OpenAI herunter, und fügen Sie sie API Management als OpenAPI-API hinzu.

Voraussetzungen

Eine bestehende API Management-Instanz. Erstellen Sie eine, falls nicht schon geschehen.

Eine Azure OpenAI-Ressource mit einem bereitgestellten Modell. Weitere Informationen zur Modellimplementierung finden Sie im Leitfaden zur Ressourcenbereitstellung.

Notieren Sie sich die ID (Name) der Bereitstellung. Sie benötigen sie, wenn Sie die importierte API in der API-Verwaltung testen.

Berechtigungen zum Gewähren des Zugriffs auf die Azure OpenAI-Ressource über die API Management-Instanz

Option 1. Importieren der API aus dem Azure OpenAI Service

Sie können eine Azure OpenAI-API direkt aus dem Azure OpenAI-Dienst in die API-Verwaltung importieren.

Hinweis

Diese Funktion ist derzeit in Arbeitsbereichen nicht verfügbar.

Wenn Sie die API importieren, konfiguriert API Management automatisch Folgendes:

- Vorgänge für jeden Azure OpenAI REST-API-Endpunkt

- Eine systemseitig zugewiesene Identität mit den erforderlichen Berechtigungen für den Zugriff auf die Azure OpenAI-Ressource

- Eine backend-Ressource und eine set-backend-service-Richtlinie, die API-Anforderungen an den Azure OpenAI Service-Endpunkt weiterleitet

- Eine authentication-managed-identity-Richtlinie, die sich mithilfe der systemseitig zugewiesenen Identität der Instanz bei der Azure OpenAI-Ressource authentifizieren kann

- (optional) Richtlinien zur Überwachung und Verwaltung der Tokennutzung durch die Azure OpenAI-API

So importieren Sie eine Azure OpenAI-API in API Management:

Navigieren Sie im Azure-Portal zu Ihrer API Management-Instanz.

Wählen Sie im linken Menü unter APIs die Option APIs>+ API hinzufügen aus.

Wählen Sie unter Aus Azure-Ressource erstellen die Option Azure OpenAI Service aus.

Gehen Sie auf der Registerkarte Grundlagen wie folgt vor:

Wählen Sie die Azure OpenAI-Ressource aus, die Sie importieren möchten.

Wählen Sie optional eine Azure OpenAI-API-Version aus. Wenn Sie keine Version auswählen, wird standardmäßig die neueste produktionsfähige REST-API-Version verwendet.

Geben Sie einen Anzeigenamen und optional eine Beschreibung für die API ein.

Fügen Sie in Basis-URL einen Pfad an, den Ihre API Management-Instanz für den Zugriff auf die Azure OpenAI-API-Endpunkte verwendet. Wenn Sie OpenAI SDK-Kompatibilität sicherstellen aktivieren (empfohlen), wird

/openaiautomatisch an die Basis-URL angefügt.Wenn Ihr API Management-Gatewayendpunkt beispielsweise

https://contoso.azure-api.netlautet, legen Sie eine Basis-URL wiehttps://contoso.azure-api.net/my-openai-api/openaifest.Wählen Sie optional ein oder mehrere Produkte aus, die mit der API verknüpft werden sollen. Wählen Sie Weiter aus.

Aktivieren Sie auf der Registerkarte Richtlinien optional Richtlinien zum Überwachen und Verwalten der Azure OpenAI-API-Tokennutzung. Wenn diese Option ausgewählt ist, geben Sie Einstellungen ein, oder akzeptieren Sie die Standardeinstellungen, die die Richtlinien

azure-openai-token-limitundazure-openai-emit-token-metricfür Ihre API definieren. Sie können die Richtlinienkonfiguration auch später festlegen oder aktualisieren. Klicken Sie auf Überprüfen + erstellen.Wählen Sie nach der Überprüfung Ihrer Einstellungen Erstellen aus.

Option 2. Hinzufügen der OpenAPI-Spezifikation zu API Management

Alternativ können Sie die OpenAPI-Spezifikation für die Azure OpenAI REST-API manuell herunterladen und API Management als OpenAPI-API hinzufügen.

Herunterladen der OpenAPI-Spezifikation

Laden Sie die OpenAPI-Spezifikation für die Azure OpenAI REST-API herunter, z. B. die GA-Version2024-02-01.

Öffnen Sie in einem Text-Editor die von Ihnen heruntergeladene Spezifikationsdatei.

Ersetzen Sie im

servers-Element in der Spezifikation den Namen Ihres Azure OpenAI Service-Endpunkts in den Platzhalterwerte fürurlunddefault-Endpunkt in der Spezifikation. Wenn Ihr Azure OpenAI Service-Endpunkt beispielsweisecontoso.openai.azure.comlautet, aktualisieren Sie dasservers-Element mit den folgenden Werten:- URL:

https://contoso.openai.azure.com/openai - Standardendpunkt:

contoso.openai.azure.com

[...] "servers": [ { "url": "https://contoso.openai.azure.com/openai", "variables": { "endpoint": { "default": "contoso.openai.azure.com" } } } ], [...]- URL:

Notieren Sie sich den Wert der API

versionin der Spezifikation. Sie benötigen sie, um die API zu testen. Beispiel:2024-02-01.

Importieren der OpenAPI-Spezifikation in API Management

- Navigieren Sie im Azure-Portal zu Ihrer API Management-Instanz.

- Wählen Sie im linken Menü APIs>+ API hinzufügen aus.

- Wählen Sie unter Neue API definieren die Option gRPC aus. Geben Sie einen Anzeigenamen und einen Namen für die API ein.

- Geben Sie ein API-URL-Suffix ein, das mit

/openaiendet, um auf die Azure OpenAI-API-Endpunkte in Ihrer API Management-Instanz zuzugreifen. Beispiel:my-openai-api/openai. - Klicken Sie auf Erstellen.

Die API wird importiert und zeigt Vorgänge aus der OpenAPI-Spezifikation an.

Konfigurieren der Authentifizierung bei der Azure OpenAI-API

Um sich bei der Azure OpenAI-API zu authentifizieren, geben Sie einen API-Schlüssel oder eine verwaltete Identität an. Wenn Sie die Azure OpenAI-API direkt in Ihre API Management-Instanz importiert haben, wird die Authentifizierung mit der verwalteten Identität der API Management-Instanz automatisch konfiguriert.

Wenn Sie die Azure OpenAI-API aus der OpenAPI-Spezifikation hinzugefügt haben, müssen Sie die Authentifizierung konfigurieren. Weitere Informationen über das Konfigurieren der Authentifizierung mithilfe von API Management-Richtlinien finden Sie unter Authentifizieren und Autorisieren der Azure OpenAI-API.

Testen der Azure OpenAI-API

Um sicherzustellen, dass Ihre Azure OpenAI-API erwartungsgemäß funktioniert, testen Sie sie in der API Management-Testkonsole. Sie müssen die Modellimplementierungs-ID (Name) angeben, die in der Azure OpenAI-Ressource konfiguriert ist, um die API zu testen.

Wählen Sie die API aus, die Sie im vorherigen Schritt erstellt haben.

Wählen Sie die Registerkarte Testen aus.

Wählen Sie einen Vorgang aus, der mit dem in der Azure OpenAI-Ressource implementierten Modell kompatibel ist. Auf der Seite werden Felder für Parameter und Header angezeigt.

Geben Sie in Vorlagenparameter die folgenden Werte ein:

Geben Sie bei Bedarf weitere Parameter und Header ein. Je nach Vorgang müssen Sie möglicherweise einen Anforderungstextkonfigurieren oder aktualisieren.

Hinweis

In der Testkonsole füllt API Management automatisch einen Ocp-Apim-Subscription-Key-Header auf und konfiguriert den Abonnementschlüssel des integrierten All-Access-Abonnements. Dieser Schlüssel ermöglicht den Zugriff auf jede API in der API Management-Instanz. Optional können Sie den Ocp-Apim-Subscription-Key-Header anzeigen, indem Sie das Augensymbol neben der HTTP-Anforderung auswählen.

Wählen Sie Send (Senden) aus.

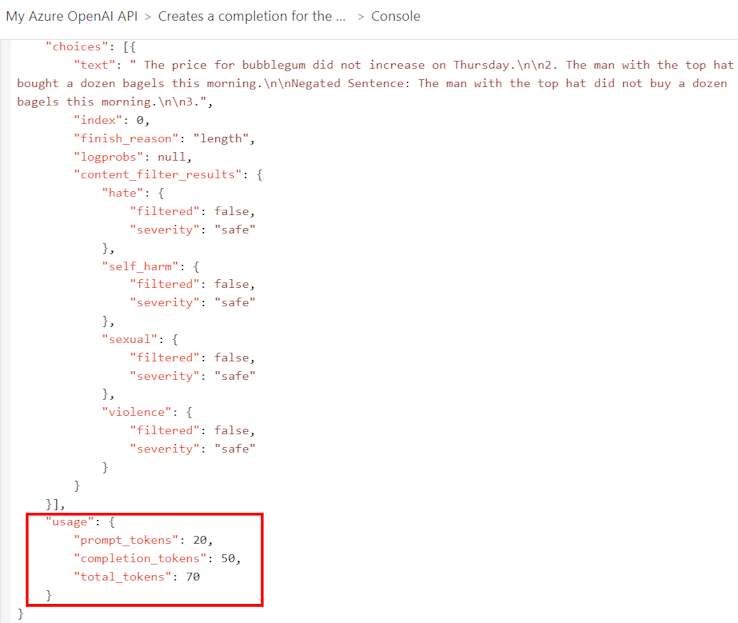

Wenn der Test erfolgreich ist, antwortet das Back-End mit einem erfolgreichen HTTP-Antwortcode und einigen Daten. An die Antwort angefügt werden Tokennutzungsdaten, die Ihnen helfen, Ihre Azure OpenAI-API-Nutzung zu überwachen und zu verwalten.

Zwischenspeicherungsrichtlinien für Azure OpenAI-APIs

Neben den Richtlinien azure-openai-token-limit und azure-openai-emit-token-metric, die Sie beim Importieren einer Azure OpenAI Service-API konfigurieren können, bietet API Management die folgenden Zwischenspeicherungsrichtlinien, um die Leistung zu optimieren und die Latenz für Azure OpenAI-APIs zu verringern:

azure-openai-semantic-cache-storeazure-openai-semantic-cache-lookup

Zugehöriger Inhalt

Zugehörige Themen

- Einschränkungen beim API-Import

- Importieren einer OpenAPI-Spezifikation

- Importieren einer SOAP-API

- Importieren einer SOAP-API und Konvertieren dieser in REST

- Importieren einer App Service-API

- Importieren einer Container-App-API

- Importieren einer WebSocket-API

- Importieren einer GraphQL-API

- Importieren eines GraphQL-Schemas und Einrichten von Feldauflösern

- Importieren einer Azure Functions-App als API

- Importieren einer Logik-App als API

- Tutorial: Integrieren von API Management in Service Fabric in Azure

- Importieren einer Azure OpenAI-API

- Importieren einer OData-API

- Importieren von SAP OData-Metadaten

- Importieren einer gRPC-API

- Bearbeiten von APIs