Considerazioni per Gestione della postura di sicurezza dei dati per l'intelligenza artificiale & protezione della sicurezza dei dati e della conformità per Copilot

Linee guida sulle licenze di Microsoft 365 per la sicurezza & conformità

Quando si comprende come usare Gestione della postura di sicurezza dei dati di Microsoft Purview per l'intelligenza artificiale e altre funzionalità per gestire le protezioni di sicurezza e conformità dei dati per Microsoft 365 Copilot e Microsoft Copilot, usare le informazioni dettagliate seguenti per eventuali prerequisiti, considerazioni ed esenzioni applicabili all'organizzazione. Per Microsoft Copilot, assicurarsi di leggerli insieme ai requisiti di Microsoft 365 Copilot e alla protezione dei dati aziendali in Copilot per Microsoft 365 e Microsoft Copilot.

Per informazioni sulle licenze per l'uso di queste funzionalità per Copilot, vedere i collegamenti relativi alle licenze e alla descrizione del servizio nella parte superiore della pagina. Per informazioni sulle licenze per Copilot, vedere la descrizione del servizio per Microsoft 365 Copilot.

Gestione della postura di sicurezza dei dati per l'intelligenza artificiale prerequisiti e considerazioni

Per la maggior parte, Gestione della postura di sicurezza dei dati per l'intelligenza artificiale è facile da usare e autoesplicatore, guidando l'utente attraverso i prerequisiti e i report e i criteri preconfigurati. Usare questa sezione per integrare tali informazioni e fornire altri dettagli che potrebbero essere necessari.

Prerequisiti per Gestione della postura di sicurezza dei dati per l'intelligenza artificiale

Per usare Gestione della postura di sicurezza dei dati per l'intelligenza artificiale dal portale di Microsoft Purview o dal Portale di conformità di Microsoft Purview, è necessario disporre dei prerequisiti seguenti:

Si dispone delle autorizzazioni appropriate.

Obbligatorio per il monitoraggio delle interazioni con Copilot:

Agli utenti viene assegnata una licenza per Microsoft 365 Copilot.

Il controllo di Microsoft Purview è abilitato per l'organizzazione. Anche se si tratta dell'impostazione predefinita, è possibile controllare le istruzioni per Attivare o disattivare il controllo.

Obbligatorio per il monitoraggio delle interazioni con siti di IA generativi di terze parti:

I dispositivi vengono caricati in Microsoft Purview, necessari per:

- Ottenere visibilità sulle informazioni sensibili condivise con siti di intelligenza artificiale generativa di terze parti. Ad esempio, un utente incolla i numeri di carta di credito in ChatGPT.

- Applicazione di criteri di prevenzione della perdita dei dati degli endpoint per avvisare o impedire agli utenti di condividere informazioni riservate con siti di intelligenza artificiale generativi di terze parti. Ad esempio, un utente identificato come rischio elevato in Protezione adattiva è bloccato con l'opzione di sostituzione quando incolla i numeri di carta di credito in ChatGPT.

L'estensione del browser Microsoft Purview viene distribuita agli utenti e deve individuare le visite ai siti di intelligenza artificiale generativa di terze parti.

Sono disponibili altre informazioni sui prerequisiti per il controllo, l'onboarding dei dispositivi e l'estensione del browser in Gestione della postura di sicurezza dei dati per l'intelligenza artificiale: Passare alla sezione Panoramica>Introduzione.

Per un elenco delle app di intelligenza artificiale di terze parti attualmente supportate, vedere Siti di intelligenza artificiale supportati da Microsoft Purview per le protezioni di sicurezza e conformità dei dati.

Nota

Anche se le unità amministrative sono supportate per i report e Activity Explorer in Gestione della postura di sicurezza dei dati di Microsoft Purview per l'intelligenza artificiale, non sono supportate per i criteri con un clic. Ciò significa che un amministratore assegnato a un'unità amministrativa specifica visualizzerà i risultati solo per gli utenti nell'unità amministrativa assegnata, ma potrà creare criteri per tutti gli utenti.

Criteri con un clic da Gestione della postura di sicurezza dei dati per l'intelligenza artificiale

Dopo aver creato i criteri predefiniti, è possibile visualizzarli e modificarli in qualsiasi momento dalle rispettive aree della soluzione nel portale. Ad esempio, si vuole definire l'ambito dei criteri per utenti specifici durante il test o per i requisiti aziendali. In alternativa, si vogliono aggiungere o rimuovere classificatori usati per rilevare informazioni riservate. Usare la pagina Criteri per passare rapidamente alla posizione corretta nel portale.

Se si elimina uno dei criteri, il relativo stato nella pagina Criteri visualizza PendingDeletion e continua a essere visualizzato come creato nelle rispettive schede di raccomandazione fino al completamento del processo di eliminazione.

Per le etichette di riservatezza e i relativi criteri, visualizzarli e modificarli in modo indipendente da Gestione della postura di sicurezza dei dati per l'intelligenza artificiale, passando a Information Protection nel portale. Per altre informazioni, usare i collegamenti di configurazione in Etichette e criteri predefiniti per proteggere i dati.

Per altre informazioni sulle azioni DLP supportate e sulle piattaforme che le supportano, vedere le prime due righe della tabella dalle attività endpoint su cui è possibile monitorare ed eseguire azioni.

Per i criteri predefiniti che usano Protezione adattiva, questa funzionalità è attivata se non è già attiva, usando i livelli di rischio predefiniti per tutti gli utenti e i gruppi per applicare dinamicamente le azioni di protezione. Per altre informazioni, vedere Configurazione rapida

Nota

Tutti i criteri predefiniti creati durante Gestione della postura di sicurezza dei dati per l'intelligenza artificiale erano in anteprima e denominati Microsoft Purview Hub IA non verranno modificati. Ad esempio, i nomi dei criteri mantengono il prefisso Microsoft Hub IA - .

Criteri predefiniti per l'individuazione dei dati tramite Gestione della postura di sicurezza dei dati per l'intelligenza artificiale

Criteri di prevenzione della perdita dei dati: DSPM per l'intelligenza artificiale: rilevare le informazioni sensibili aggiunte ai siti di intelligenza artificiale

Questo criterio individua i contenuti sensibili incollati o caricati in Microsoft Edge, Chrome e Firefox nei siti di intelligenza artificiale. Questo criterio copre tutti gli utenti e i gruppi dell'organizzazione solo in modalità di controllo.

Criteri di gestione dei rischi Insider: DSPM per l'intelligenza artificiale - Rilevare quando gli utenti visitano i siti di intelligenza artificiale

Rileva quando gli utenti usano un browser per visitare i siti di intelligenza artificiale.

Criteri di gestione dei rischi Insider: DSPM per l'intelligenza artificiale - Rilevare l'utilizzo rischioso dell'IA

Questo criterio consente di calcolare il rischio utente rilevando richieste e risposte rischiose in Microsoft 365 Copilot e in altre app di intelligenza artificiale generative.

Criteri di gestione dei rischi Insider: DSPM per l'intelligenza artificiale - Comportamento non etico in Copilot

Questo criterio rileva le informazioni sensibili nelle richieste e nelle risposte in Microsoft 365 Copilot. Questo criterio riguarda tutti gli utenti e i gruppi dell'organizzazione.

Criteri predefiniti della sicurezza dei dati per proteggere i dati sensibili usati nell'intelligenza artificiale generativa

Criteri DLP DSPM per l'intelligenza artificiale - Bloccare le informazioni sensibili dai siti di intelligenza artificiale

Questo criterio usa Protezione adattiva per fornire un blocco con override agli utenti a rischio elevato che tentano di incollare o caricare informazioni sensibili in altre app per intelligenza artificiale in Edge, Chrome e Firefox. Questo criterio copre tutti gli utenti e i gruppi dell'organizzazione in modalità test.

Azure Information Protection

Questa opzione crea etichette di riservatezza predefinite e criteri di etichetta di riservatezza.

Se sono già state configurate le etichette di riservatezza e i relativi criteri, questa configurazione viene ignorata.

Eventi di Esplora attività

Usare le informazioni seguenti per comprendere gli eventi che potrebbero essere visualizzati in Esplora attività da Gestione della postura di sicurezza dei dati per l'intelligenza artificiale. I riferimenti a un sito generativo di intelligenza artificiale possono includere Microsoft 365 Copilot, altri copiloti Microsoft e siti di intelligenza artificiale di terze parti.

| Evento | Descrizione |

|---|---|

| Interazione con l'intelligenza artificiale | L'utente ha interagito con un sito di intelligenza artificiale generativa. I dettagli includono le richieste e le risposte. |

| Visita al sito Web di intelligenza artificiale | L'utente è stato visualizzato in un sito di intelligenza artificiale generativa. |

| Corrispondenza della regola DLP | Una regola di prevenzione della perdita dei dati è stata confrontata quando un utente ha interagito con un sito di intelligenza artificiale generativa Include la prevenzione della perdita dei dati per Microsoft 365 Copilot. |

| Tipi di informazioni sensibili | I tipi di informazioni sensibili sono stati trovati mentre un utente interagisce con un sito di intelligenza artificiale generativa. |

L'evento di interazione con intelligenza artificiale non visualizza sempre testo per la richiesta e la risposta di Copilot. In alcuni casi, la richiesta e la risposta si estendono su voci consecutive. Altri scenari possono includere:

- Copilot per Word, quando un utente seleziona Inspire me per un documento esistente, non viene visualizzato alcun prompt

- Copilot per Word, quando un documento non ha contenuto o ha contenuto ma non viene salvato, non viene visualizzato alcun prompt o risposta

- Copilot per Excel, quando un utente chiede di generare informazioni dettagliate sui dati, non viene visualizzato alcun prompt o risposta

- Copilot per Excel, quando un utente chiede di evidenziare celle o formato, non viene visualizzato alcun prompt o risposta

- Copilot per PowerPoint, quando una presentazione non viene salvata, non viene visualizzato alcun prompt o risposta

- Copilot per Teams, non viene visualizzato alcun prompt

- Copilot per Whiteboard, non viene visualizzato alcun prompt o risposta

- Copilot in Forms, non viene visualizzata alcuna richiesta o risposta

L'evento Tipi di informazioni sensibili rilevati non visualizza il livello di rischio utente.

Considerazioni sulla protezione delle informazioni per Copilot

Microsoft 365 Copilot ha la possibilità di accedere ai dati archiviati all'interno del tenant di Microsoft 365, incluse le cassette postali in Exchange Online e i documenti in SharePoint o OneDrive.

Oltre ad accedere al contenuto di Microsoft 365, Copilot può anche usare il contenuto del file specifico su cui si sta lavorando nel contesto di una sessione di app di Office, indipendentemente dalla posizione in cui è archiviato il file. Ad esempio, archiviazione locale, condivisioni di rete, archiviazione cloud o una chiavetta USB. Quando i file vengono aperti da un utente all'interno di un'app, l'accesso viene spesso definito dati in uso.

Prima di distribuire Microsoft 365 Copilot, assicurarsi di avere familiarità con i dettagli seguenti che consentono di rafforzare le soluzioni di protezione dei dati:

Se il contenuto concede a un utente i diritti di utilizzo VIEW ma non EXTRACT:

- Quando un utente ha aperto questo contenuto in un'app, non sarà in grado di usare Copilot.

- Copilot non riepiloga questo contenuto, ma può farvi riferimento con un collegamento in modo che l'utente possa quindi aprire e visualizzare il contenuto all'esterno di Copilot.

È possibile impedire ulteriormente ai Microsoft 365 Copilot di riepilogare i file etichettati (crittografati o meno) identificati da un criterio di Protezione dalla perdita dei dati di Microsoft Purview. Copilot non riepiloga questo contenuto, ma può farvi riferimento con un collegamento in modo che l'utente possa quindi aprire e visualizzare il contenuto all'esterno di Copilot.

Proprio come le app di Office, Microsoft 365 Copilot possono accedere alle etichette di riservatezza dall'organizzazione, ma non da altre organizzazioni. Per altre informazioni sul supporto per l'etichettatura tra le organizzazioni, vedere Supporto per utenti esterni e contenuto etichettato.

Un'impostazione avanzata di PowerShell per le etichette di riservatezza può impedire alle app di Office di inviare contenuto ad alcune esperienze connesse, tra cui Microsoft 365 Copilot.

Copilot non può accedere ai documenti non aperti in SharePoint e OneDrive quando vengono etichettati e crittografati con autorizzazioni definite dall'utente. Copilot può accedere a questi documenti per un utente quando è aperto nell'app (dati in uso).

Copilot non può accedere ai documenti non aperti in SharePoint configurati con un'etichetta di riservatezza predefinita che estende le autorizzazioni di SharePoint ai documenti scaricati.

Le etichette di riservatezza applicate a gruppi e siti (note anche come "etichette contenitore") non vengono ereditate dagli elementi in tali contenitori. Di conseguenza, gli elementi non visualizzano l'etichetta del contenitore in Copilot e non possono supportare l'ereditarietà delle etichette di riservatezza. Ad esempio, i messaggi di chat del canale di Teams riepilogati da un team etichettato come Riservato non visualizzeranno tale etichetta per il contesto di riservatezza in Business Chat. Analogamente, il contenuto delle pagine e degli elenchi del sito di SharePoint non visualizzerà l'etichetta di riservatezza dell'etichetta del contenitore.

Se si usano le impostazioni della libreria IRM (Information Rights Management) di SharePoint che impediscono agli utenti di copiare testo, tenere presente che i diritti di utilizzo vengono applicati quando i file vengono scaricati e non quando vengono creati o caricati in SharePoint. Se non si vuole che Copilot riepiloghi questi file quando sono inattivi, usare etichette di riservatezza che applicano la crittografia senza il diritto di utilizzo EXTRACT.

A differenza di altri scenari di etichettatura automatica, un'etichetta ereditata quando si crea nuovo contenuto sostituirà un'etichetta con priorità inferiore applicata manualmente.

Quando non è possibile applicare un'etichetta di riservatezza ereditata, il testo non verrà aggiunto all'elemento di destinazione. Ad esempio:

- L'elemento di destinazione è di sola lettura

- L'elemento di destinazione è già crittografato e l'utente non ha le autorizzazioni per modificare l'etichetta (richiede diritti di utilizzo EXPORT o FULL CONTROL)

- L'etichetta di riservatezza ereditata non viene pubblicata per l'utente

Se un utente chiede a Copilot di creare nuovo contenuto da elementi etichettati e crittografati, l'ereditarietà delle etichette non è supportata quando la crittografia è configurata per le autorizzazioni definite dall'utente o se la crittografia è stata applicata in modo indipendente dall'etichetta. L'utente non sarà in grado di inviare questi dati all'elemento di destinazione.

Poiché DKE (Double Key Encryption) è destinato ai dati più sensibili soggetti ai requisiti di protezione più rigorosi, Copilot non può accedere a questi dati. Di conseguenza, gli elementi protetti da DKE non verranno restituiti da Copilot e, se un elemento DKE è aperto (dati in uso), non sarà possibile usare Copilot nell'app.

Le etichette di riservatezza che proteggono le riunioni e le chat di Teams non sono attualmente riconosciute da Copilot. Ad esempio, i dati restituiti da una chat di riunione o da una chat del canale non visualizzano un'etichetta di riservatezza associata, non è possibile impedire la copia dei dati della chat per un elemento di destinazione e l'etichetta di riservatezza non può essere ereditata. Questa limitazione non si applica agli inviti alle riunioni, alle risposte e agli eventi del calendario protetti dalle etichette di riservatezza.

Per Business Chat (in precedenza noto come chat basata su grafico e Microsoft 365 Chat):

- Quando agli inviti alla riunione viene applicata un'etichetta di riservatezza, l'etichetta viene applicata al corpo dell'invito alla riunione, ma non ai metadati, ad esempio data e ora, o ai destinatari. Di conseguenza, le domande basate solo sui metadati restituiscono dati senza l'etichetta. Ad esempio, "Quali riunioni ho il lunedì?" Le domande che includono il corpo della riunione, ad esempio l'agenda, restituiscono i dati come etichettati.

- Se il contenuto viene crittografato in modo indipendente dall'etichetta di riservatezza applicata e tale crittografia non concede all'utente i diritti di utilizzo EXTRACT (ma include il diritto di utilizzo VIEW), il contenuto può essere restituito da Copilot e quindi inviato a un elemento di origine. Esempio di quando questa configurazione può verificarsi se un utente ha applicato restrizioni di Office da Information Rights Management quando un documento è etichettato come "Generale" e tale etichetta non applica la crittografia.

- Quando al contenuto restituito è applicata un'etichetta di riservatezza, gli utenti non visualizzeranno l'opzione Modifica in Outlook perché questa funzionalità non è attualmente supportata per i dati etichettati.

- Se si usano le funzionalità di estensione che includono plug-in e Microsoft Graph Connector, le etichette di riservatezza e la crittografia applicate a questi dati da origini esterne non vengono riconosciute da Business Chat. La maggior parte delle volte questa limitazione non viene applicata perché è improbabile che i dati supportano le etichette di riservatezza e la crittografia, anche se un'eccezione è costituita dai dati di Power BI. È sempre possibile disconnettere le origini dati esterne usando il interfaccia di amministrazione di Microsoft 365 per disattivare i plug-in per gli utenti e disconnettere le connessioni che usano un connettore API Graph.

Eccezioni specifiche dell'app:

Microsoft 365 Copilot in Outlook: è necessario disporre di una versione minima di Outlook per usare Microsoft 365 Copilot per gli elementi crittografati in Outlook:

- Outlook (versione classica) per Windows: a partire dalla versione 2408 in Current Channel e Monthly Enterprise Channel

- Outlook per Mac: versione 16.86.609+

- Outlook per iOS: versione 4.2420.0+

- Outlook per Android: versione 4.2420.0+

- Outlook sul web: Sì

- Nuovo Outlook per Windows: Sì

Microsoft 365 Copilot in EdgeMicrosoft 365 Copilot in Windows: a meno che non venga usata la prevenzione della perdita dei dati in Edge, Copilot può fare riferimento al contenuto crittografato dalla scheda del browser attivo in Edge quando tale contenuto non concede i diritti di utilizzo EXTRACT dell'utente. Ad esempio, il contenuto crittografato proviene da Office per il web o Outlook per il web.

Verrà eseguito l'override di un'etichetta esistente per l'ereditarietà dell'etichetta di riservatezza?

Riepilogo dei risultati quando Copilot applica automaticamente la protezione con ereditarietà delle etichette di riservatezza:

| Etichetta esistente | Eseguire l'override con ereditarietà delle etichette di riservatezza |

|---|---|

| Applicato manualmente, priorità inferiore | Sì |

| Applicato manualmente, priorità più alta | No |

| Applicata automaticamente, priorità inferiore | Sì |

| Applicata automaticamente, priorità più alta | No |

| Etichetta predefinita dai criteri, priorità inferiore | Sì |

| Etichetta predefinita dai criteri, priorità più alta | No |

| Etichetta di riservatezza predefinita per una raccolta documenti, priorità inferiore | Sì |

| Etichetta di riservatezza predefinita per una raccolta documenti, priorità più alta | No |

Copilot rispetta la protezione esistente con il diritto di utilizzo EXTRACT

Anche se non si ha familiarità con i singoli diritti di utilizzo per il contenuto crittografato, sono stati circa un lungo periodo di tempo. Da Windows Server Rights Management, ad Active Directory Rights Management, alla versione cloud che è diventata Azure Information Protection con il servizio Azure Rights Management.

Se hai ricevuto un messaggio di posta elettronica "Non inoltrare", usa i diritti di utilizzo per impedirti di inoltrare il messaggio dopo l'autenticazione. Come per altri diritti di utilizzo in bundle mappati a scenari aziendali comuni, un messaggio di posta elettronica Non inoltrare concede ai destinatari diritti di utilizzo che controllano le operazioni che possono eseguire con il contenuto e non include il diritto di utilizzo FORWARD. Oltre a non inoltrare, non è possibile stampare questo messaggio di posta elettronica Non inoltrare o copiare testo da esso.

Il diritto di utilizzo che concede l'autorizzazione per la copia del testo è EXTRACT, con il nome più semplice e comune di Copia. È questo diritto di utilizzo che determina se Microsoft 365 Copilot può visualizzare testo all'utente da contenuto crittografato.

Nota

Poiché il diritto di utilizzo Controllo completo (OWNER) include tutti i diritti di utilizzo, EXTRACT viene incluso automaticamente con controllo completo.

Quando si usa il portale di Microsoft Purview o il Portale di conformità di Microsoft Purview per configurare un'etichetta di riservatezza per applicare la crittografia, la prima scelta è se assegnare le autorizzazioni ora o consentire agli utenti di assegnare le autorizzazioni. Se si assegnano ora, configurare le autorizzazioni selezionando un livello di autorizzazione predefinito con un gruppo predefinito di diritti di utilizzo, ad esempio Co-Author o Revisore. In alternativa, è possibile selezionare autorizzazioni personalizzate in cui è possibile selezionare singolarmente i diritti di utilizzo disponibili.

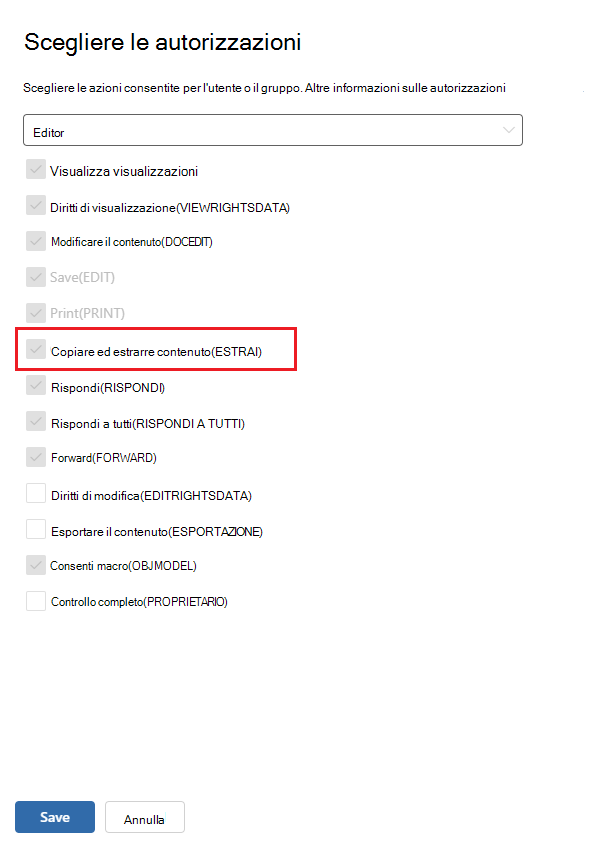

Nel portale di Microsoft Purview il diritto di utilizzo EXTRACT viene visualizzato come Copia ed estrai contenuto (EXTRACT).In the Microsoft Purview portal, the EXTRACT usage right is displayed as Copy and extract content(EXTRACT). Ad esempio, il livello di autorizzazione predefinito selezionato è Editor, in cui viene incluso Copia ed estrai contenuto (EXTRACT). Di conseguenza, il contenuto protetto con questa configurazione di crittografia può essere restituito da Microsoft 365 Copilot:

Se si seleziona Personalizzato dalla casella a discesa e quindi Controllo completo (PROPRIETARIO) dall'elenco, questa configurazione concederà anche il diritto di utilizzo EXTRACT.

Nota

La persona che applica la crittografia ha sempre il diritto di utilizzo EXTRACT, perché è il proprietario di Rights Management. Questo ruolo speciale include automaticamente tutti i diritti di utilizzo e altre azioni, il che significa che il contenuto crittografato da un utente è sempre idoneo per essere restituito da Microsoft 365 Copilot.This special role automatically includes all usage rights and some other actions, that means that content a user has encrypted themselves is always eligible to be returned to them by Microsoft 365 Copilot. Le restrizioni di utilizzo configurate si applicano ad altre persone autorizzate ad accedere al contenuto.

In alternativa, se si seleziona la configurazione di crittografia per consentire agli utenti di assegnare le autorizzazioni, per Outlook questa configurazione include autorizzazioni predefinite per Non inoltrare e Crittografa solo. L'opzione Encrypt-Only, a differenza di Non inoltrare, include il diritto di utilizzo EXTRACT.

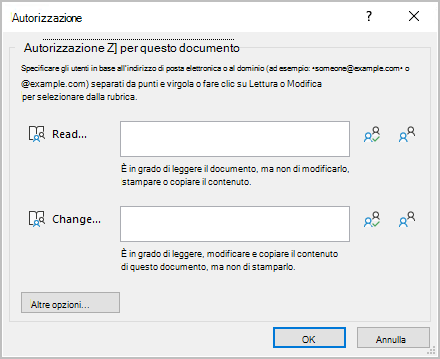

Quando si selezionano autorizzazioni personalizzate per Word, Excel e PowerPoint, gli utenti selezionano le proprie autorizzazioni nell'app di Office quando applicano l'etichetta di riservatezza. Sono attualmente disponibili due versioni della finestra di dialogo. Nella versione precedente, vengono informati che dalle due selezioni , Lettura non include l'autorizzazione per copiare il contenuto, ma cambia . Questi riferimenti da copiare fanno riferimento al diritto di utilizzo EXTRACT. Se l'utente seleziona Altre opzioni, può aggiungere il diritto di utilizzo EXTRACT a Lettura selezionando Consenti agli utenti con accesso in lettura di copiare il contenuto.

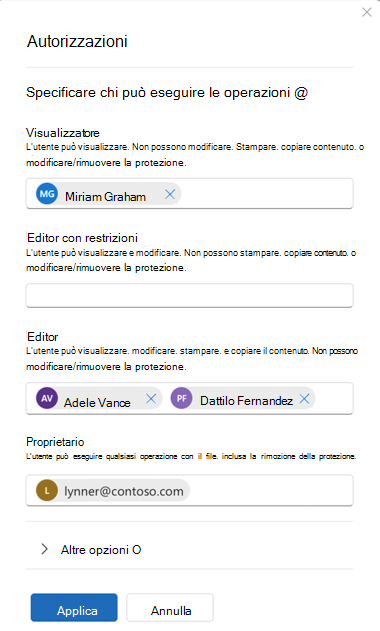

Nella versione più recente della finestra di dialogo, Lettura e modifica viene sostituito con i livelli di autorizzazione in cui le descrizioni che la copia dello stato non è consentita non includeranno il diritto di utilizzo EXTRACT. I livelli di autorizzazione che includono EXTRACT sono Editor e Owner. Ad esempio:

Consiglio

Se è necessario verificare se un documento autorizzato a visualizzare include il diritto di utilizzo EXTRACT, aprirlo nell'app di Windows Office e personalizzare la barra di stato per visualizzare Autorizzazioni. Selezionare l'icona accanto al nome dell'etichetta di riservatezza per visualizzare l'autorizzazione personale. Visualizzare il valore di Copy, mappato al diritto di utilizzo EXTRACT, e verificare se viene visualizzato Sì o No.

Per i messaggi di posta elettronica, se le autorizzazioni non vengono visualizzate nella parte superiore del messaggio in Outlook per Windows, selezionare il banner informativo con il nome dell'etichetta e quindi selezionare Visualizza autorizzazione.

Copilot rispetta il diritto di utilizzo EXTRACT per un utente, tuttavia è stato applicato al contenuto. La maggior parte delle volte, quando il contenuto è etichettato, i diritti di utilizzo concessi all'utente corrispondono a quelli della configurazione dell'etichetta di riservatezza. Esistono tuttavia alcune situazioni che possono comportare la differenza tra i diritti di utilizzo del contenuto e la configurazione dell'etichetta applicata:

- L'etichetta di riservatezza viene applicata dopo l'applicazione dei diritti di utilizzo

- I diritti di utilizzo vengono applicati dopo l'applicazione di un'etichetta di riservatezza

Per altre informazioni sulla configurazione di un'etichetta di riservatezza per la crittografia, vedere Limitare l'accesso al contenuto usando etichette di riservatezza per applicare la crittografia.

Per informazioni tecniche sui diritti di utilizzo, vedere Configurare i diritti di utilizzo per Azure Information Protection.

Considerazioni sulla gestione della conformità per Copilot

La gestione della conformità per le interazioni con Microsoft 365 Copilot e Microsoft Copilot si estende su Word, Excel, PowerPoint, Outlook, Teams, Loop e copilot pages, Whiteboard, OneNote e Business Chat (in precedenza graph-grounded) chat e Microsoft 365 Chat).

Nota

La gestione della conformità per Copilot include richieste e risposte da e verso il Web pubblico quando gli utenti hanno eseguito l'accesso e selezionano l'opzione Lavoro anziché il Web.

Gli strumenti di conformità identificano le interazioni copilot di origine in base al nome dell'app. Ad esempio, Copilot in Word, Copilot in Teams e Microsoft 365 Chat (per Business Chat e Microsoft Copilot).

Prima di distribuire Microsoft 365 Copilot e Microsoft Copilot, assicurarsi di avere familiarità con i dettagli seguenti per supportare le soluzioni di gestione della conformità:

I dati di controllo sono progettati per scopi di sicurezza e conformità dei dati e offrono visibilità completa sulle interazioni copilot per questi casi d'uso. Ad esempio, per individuare i dati per la condivisione eccessiva dei rischi o per raccogliere interazioni per motivi normativi o legali. Non è progettato per essere usato come base per la creazione di report sull'utilizzo di Copilot.

Nota

Qualsiasi metrica aggregata basata su questi dati di controllo, ad esempio "conteggio richieste" o "conteggio utenti attivo", potrebbe non essere coerente con i punti dati corrispondenti nei report ufficiali sull'utilizzo di Copilot forniti da Microsoft. Microsoft non può fornire indicazioni su come usare i dati del log di controllo come base per la creazione di report sull'utilizzo, né microsoft può stabilire che le metriche di utilizzo aggregate basate sui dati del log di controllo corrispondano a metriche di utilizzo simili segnalate in altri strumenti.

Per accedere a informazioni accurate sull'utilizzo di Copilot, usare uno dei report seguenti: il report sull'utilizzo Microsoft 365 Copilot nel Centro Amministrazione Microsoft 365 o il dashboard copilot in Viva Insights.

Il controllo acquisisce l'attività copilot della ricerca, ma non la richiesta o la risposta utente effettiva. Per queste informazioni, usare eDiscovery. In alternativa, da Gestione della postura di sicurezza dei dati di Microsoft Purview per l'intelligenza artificiale usare l'interazione con l'intelligenza artificiale dalla pagina Esplora attività.

Amministrazione modifiche correlate al controllo di Copilot non sono ancora supportate.

Le informazioni di identificazione del dispositivo non sono attualmente incluse nei dettagli di controllo.

I criteri di conservazione per le interazioni copilot non informano gli utenti quando i messaggi vengono eliminati a seguito di un criterio di conservazione.

Eccezioni specifiche dell'app:

-

Microsoft 365 Copilot in Teams:

- Se le trascrizioni sono disattivate, le funzionalità di controllo, eDiscovery e conservazione non sono supportate

- Se si fa riferimento alle trascrizioni, questa azione non viene acquisita per il controllo

- Per Business Chat in Teams, Copilot attualmente non può conservare come allegati cloud, a cui fa riferimento i file restituiti agli utenti. I file a cui fanno riferimento gli utenti sono supportati per essere conservati come allegati cloud.